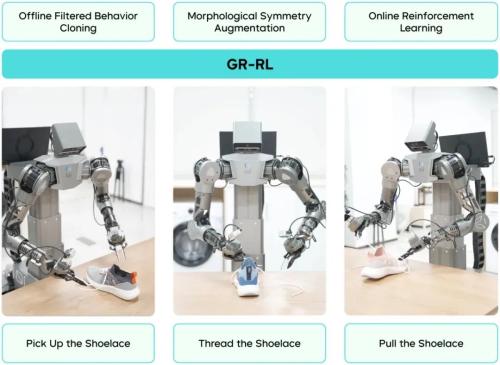

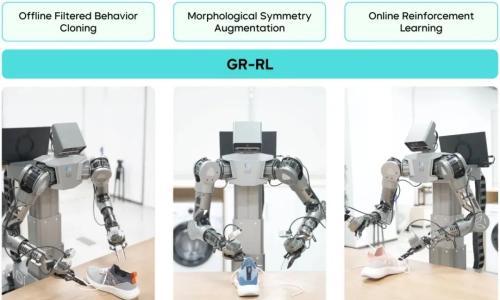

字节跳动Seed Research团队正式发布最新研究成果GR-RL,在真实机器人平台上首次实现了「连续为整只鞋穿鞋带」的复杂操作。字节跳动称,这一突破标志着视觉-语言-动作(VLA)模型在精细灵巧任务上的能力边界被显著拓展。

团队指出,主流模仿学习存在两大缺陷:人类演示数据的「次优性」以及训练与推理之间的「执行错位」,导致模型在毫米级精度任务中频繁失败。

为此,Seed团队选择真机强化学习路径,提出了多阶段训练框架,包括离线数据筛选、数据增强以及在线强化学习。在双臂机器人ByteMini-v2上,GR-RL将穿鞋带任务成功率从监督学习基线GR-3的45.7%提升至83.3%,失败率减少近70%。

其中,数据过滤、镜像增强和在线强化学习均对性能提升贡献显著。实验中,模型展现出类似人类的「纠错智能」,在鞋带滑落或摆放位置不佳时能主动调整并重试,体现了对任务物理逻辑的理解,而非单纯轨迹记忆。团队认为,强化学习经验应进一步蒸馏回基础VLA模型,以构建兼具高精度操作与强大泛化能力的通用策略。

扫一扫关注微信

扫一扫关注微信